Dirbtinio intelekto technologijos keičia ne tik mūsų kasdienybę, bet ir akademinį pasaulį. GPT Chat ir panašūs kalbos modeliai vis dažniau atsiranda studentų ir tyrėjų darbo įrankių sąraše. Tačiau kartu su naujomis galimybėmis atsiranda ir etinių dilmų – kur baigiasi pagalba ir prasideda nesąžiningas akademinis elgesys?

Šis klausimas nėra juodas ar baltas. Akademinė bendruomenė dar tik formuoja požiūrį į AI naudojimą tyrimuose, o skirtingos institucijos taiko skirtingus standartus. Viena aišku – ignoruoti šią technologiją nebėra įmanoma.

Kaip GPT keičia tyrimų procesą

Pirmiausia verta suprasti, kaip GPT Chat faktiškai keičia tyrimų metodikas. Tradiciškai literatūros apžvalga galėjo užtrukti savaites ar net mėnesius – reikėjo peržiūrėti šimtus šaltinių, išrinkti relevantiškus, analizuoti jų turinį. Dabar GPT gali per kelias minutes suteikti bendrą temos apžvalgą, išskirti pagrindinius aspektus ir net pasiūlyti tyrimo kryptis.

Tačiau čia slypi ir pirmoji spąstai. GPT generuoja tekstą remiantis savo mokymo duomenimis, kurie turi laiko ribas ir gali būti netikslūs. Pavyzdžiui, jei klausi apie 2024 metų tyrimus, modelis gali „išgalvoti” neegzistuojančius šaltinius ar statistiką. Tai vadinama „hallucinacijomis” – reiškiniu, kai AI pateikia informaciją, kuri atrodo patikima, bet iš tikrųjų yra klaidinga.

Kita vertus, GPT puikiai tinka idėjų generavimui ir struktūravimui. Jis gali padėti suformuluoti tyrimo klausimus, pasiūlyti metodologijas ar net padėti analizuoti duomenis. Svarbu tik suprasti, kad tai – įrankis, o ne tyrimo autorius.

Plagiato ir autorystės dilemos

Vienas sudėtingiausių klausimų – ar GPT generuotas tekstas yra plagiatas? Tradicinis plagiato supratimas remiasi kito asmens darbo priskyrimu sau. Bet kas yra GPT „autorystė”? Ar galima plagijuoti mašiną?

Daugelis universitetų jau atnaujino savo akademinio sąžiningumo politikas, įtraukdami AI naudojimo aspektus. Pavyzdžiui, kai kurios institucijos reikalauja aiškiai nurodyti, kuriose darbo dalyse buvo naudojamas AI, o kitos draudžia jo naudojimą visiškai.

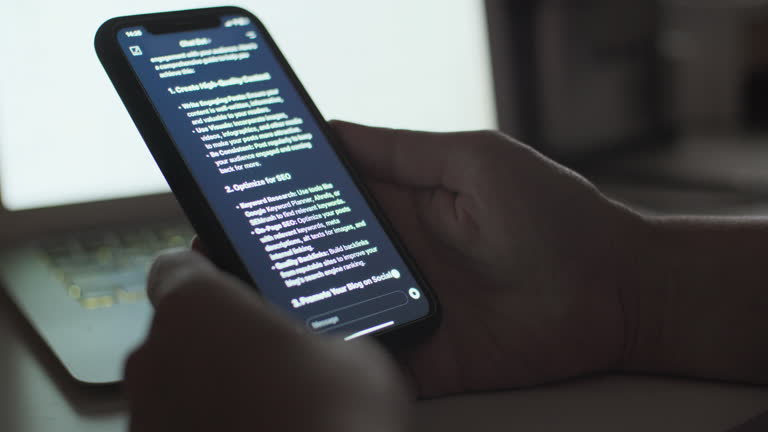

Praktiškai tai reiškia, kad studentas ar tyrėjas, naudojantis GPT, turi:

- Tikrinti savo institucijos politiką dėl AI naudojimo

- Dokumentuoti, kaip ir kur AI buvo naudojamas

- Nepateikti GPT generuoto teksto kaip savo originalaus darbo

- Visada tikrinti AI pateiktą informaciją nepriklausomais šaltiniais

Ypač atsargiai reikia elgtis su citatomis ir šaltiniais. GPT dažnai sugalvoja neegzistuojančius straipsnius ar knygas, kurios atrodo visiškai tikroviški. Kiekvienas AI paminėtas šaltinis turi būti patikrintas.

Metodologiniai iššūkiai ir galimybės

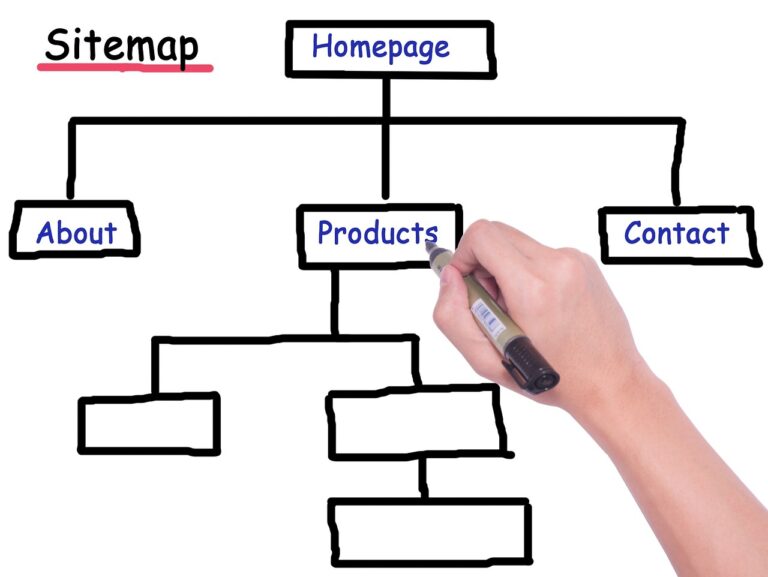

GPT Chat gali būti naudingas įvairiose tyrimo stadijose, bet kiekviena iš jų kelia specifinių etikos klausimų. Tyrimo planavimo etape AI gali padėti identifikuoti spragas literatūroje ar pasiūlyti naujus tyrimo kampus. Tačiau ar galima remtis vien AI analize, neatlikant savarankiško literatūros tyrimo?

Duomenų rinkimo stadijoje GPT gali padėti kurti apklausų klausimus ar interviu gaires. Bet jei AI formuoja tyrimo instrumentus, ar tai nepaveiks rezultatų objektyvumo? Galiausiai, duomenų analizės etape GPT gali padėti identifikuoti šablonus ar tendencijas, tačiau ar galima pasitikėti AI interpretacijomis be papildomo patikrinimo?

Kvalityviniuose tyrimuose situacija dar sudėtingesnė. Jei GPT padeda analizuoti interviu transkriptus ar koduoti duomenis, ar tai nepakeičia tyrėjo subjektyvaus požiūrio, kuris kartais yra būtinas kokybiniam tyrimui? Kai kurie ekspertai teigia, kad AI naudojimas gali padėti sumažinti tyrėjo šališkumą, kiti – kad tai gali pašalinti svarbų žmogiškąjį elementą.

Skirtingų sričių specifika

Ne visos akademinės sritys vienodai tinka AI pagalbai. Humanitarinių mokslų srityje, kur svarbus kritinis mąstymas ir interpretacija, GPT naudojimas gali būti problematiškas. Pavyzdžiui, literatūros analizėje AI gali pasiūlyti standartines interpretacijas, bet prarasti unikalų tyrėjo požiūrį.

Socialiniuose moksluose GPT gali būti naudingas analizuojant didelius duomenų kiekius ar identifikuojant tendencijas. Tačiau čia svarbu atsiminti, kad AI mokymo duomenyse gali būti įkoduoti tam tikri šališkumai, kurie paveiks analizės rezultatus.

Tikslieji mokslai ir inžinerija, regis, lengviau adaptuoja AI technologijas. Čia GPT gali padėti su skaičiavimais, kodo rašymu ar duomenų vizualizacija. Bet net ir šiose srityse svarbu suprasti AI ribas – pavyzdžiui, GPT gali padaryti matematikos klaidas ar pasiūlyti neoptimalius algoritmus.

Medicinos ir biologijos srityse AI naudojimas ypač jautrus, nes klaidos gali turėti rimtų pasekmių. Čia GPT gali būti naudingas literatūros analizei ar hipotezių generavimui, bet jokiu būdu negali pakeisti ekspertų vertinimo ar klinikinių tyrimų.

Praktiniai patarimai sąžiningam naudojimui

Jei nusprendėte naudoti GPT savo tyrimuose, štai keletas praktinių rekomendacijų, kaip tai daryti etiškai:

Skaidrumo principas: Visada dokumentuokite, kaip naudojote AI. Sukurkite atskirą failą, kuriame fiksuosite visus GPT užklausas ir gautus atsakymus. Tai padės ne tik jums atsiskaityti, bet ir kitiems tyrėjams suprasti jūsų metodologiją.

Tikrinimo kultūra: Niekada nepasitikėkite GPT pateikta informacija be patikrinimo. Sukurkite sau taisyklę – kiekvienas AI paminėtas faktas, statistika ar šaltinis turi būti patikrintas nepriklausomai. Tai ypač svarbu, kai AI pateikia konkrečius skaičius ar cituoja tyrimus.

Ribų supratimas: Naudokite GPT tam, kam jis tinka geriausiai – idėjų generavimui, struktūravimui, pirminio teksto redagavimui. Bet nepasikliaujame juo kritiniams sprendimams ar galutinėms išvadoms. Jūsų ekspertizė ir kritinis mąstymas turi likti pagrindinis tyrimo variklis.

Institucijos politikos laikymasis: Prieš pradėdami naudoti AI, išsiaiškinkite savo universiteto ar tyrimų institucijos poziciją. Kai kurios organizacijos reikalauja išankstinio leidimo, kitos – tik atsiskaitymo tyrimo pabaigoje.

Ateities perspektyvos ir standartų formavimas

Akademinė bendruomenė aktyviai diskutuoja apie AI naudojimo standartus. Jau dabar formuojasi kelios pagrindinės kryptys: visiško draudimo, kontroliuojamo naudojimo ir laisvo naudojimo su atsiskaitymu.

Tikėtina, kad ateityje matysime specializuotų AI įrankių, skirtų akademiniams tyrimams, atsiradimą. Šie įrankiai galės būti labiau patikimi, turės geresnę šaltinių kontrolę ir bus pritaikyti specifinėms sritims.

Taip pat formuojasi naujos profesijos – AI etikos konsultantai universitetuose, kurie padės tyrėjams navigoti šiose sudėtingose srityse. Kai kurios institucijos jau įsteigė specialius komitetus, kurie vertina AI naudojimo etikos aspektus tyrimuose.

Svarbu ir tai, kad keičiasi pats tyrimo proceso supratimas. Jei anksčiau tyrėjo gebėjimas rasti ir apdoroti informaciją buvo kritinis, dabar svarbiau tampa gebėjimas užduoti teisingus klausimus, kritiškai vertinti gautą informaciją ir formuoti originalias išvadas.

Balanso paieškos: technologijos ir sąžiningumo sintezė

GPT Chat ir kiti AI įrankiai nėra nei absoliutus blogis, nei stebuklingas sprendimas akademiniams iššūkiams. Tai galingi įrankiai, kurie, kaip ir bet kokie kiti, reikalauja atsakingo naudojimo.

Svarbiausias principas – skaidrumas ir sąžiningumas. Jei galite atvirai pasakyti, kaip naudojote AI savo tyrime, ir jei tai nepakeičia jūsų darbo esmės, greičiausiai elgiatės etiškai. Jei slepiате AI naudojimą ar pasikliaujate juo kritiniams sprendimams, tikriausiai peržengiate etikos ribas.

Akademinė bendruomenė dar tik mokosi gyventi su šiomis technologijomis. Standartai formuojasi, diskusijos tęsiasi, o technologijos sparčiai tobulėja. Svarbiausia – išlaikyti akademinio sąžiningumo dvasią, prisitaikant prie naujų realijų.

Galiausiai, AI turėtų papildyti, o ne pakeisti žmogaus intelektą tyrimuose. Geriausi rezultatai atsiranda tada, kai technologijos galimybės derinamos su žmogiškuoju kritiniu mąstymu, kūrybiškumu ir etikos jausmu. Tai ir yra tikrasis iššūkis – rasti tą tobulą balansą tarp efektyvumo ir sąžiningumo.